AI Engineering

EU AI Act 2026: Nową przewagą w AI jest control stack

Feb 20, 2026 · 6 min read

Europa nie tylko reguluje AI. Nagradza zespoły, które potrafią pokazać traceability, transparency, human oversight i monitoring w samym produkcie.

Europa jest już w fazie wdrożenia

Wiele zespołów wciąż mówi o EU AI Act tak, jakby wszystko zaczynało się dopiero w 2026. To już nie jest aktualne.

Na 9 marca 2026 Europa nie czeka z governance dla AI. Część obowiązków już działa.

Od 2 lutego 2025 obowiązują przepisy o zakazanych praktykach, definicja systemu AI i obowiązek AI literacy. Od 2 sierpnia 2025 doszły obowiązki dla GPAI i warstwa governance.

To zmienia realne pytanie dla product teamów. To pytanie nie brzmi już:

"Czy powinniśmy kiedyś pomyśleć o trust i kontroli?"

Tylko:

"Czy umiemy już dziś pokazać, że ten system jest zrozumiały, kontrolowalny i monitorowany?"

To nie jest porada prawna. To jest produktowa i inżynierska interpretacja tego, co rynek zaczyna nagradzać.

Dlaczego 2 sierpnia 2026 dalej ma znaczenie

Wokół AI Act jest za dużo luźnych komentarzy o opóźnieniach. Oficjalny timeline Komisji dalej jest jasny w jednej sprawie: 2 sierpnia 2026 pozostaje głównym milestone'em.

Ta data dalej ma znaczenie, bo jest powiązana z:

- szeroką falą stosowania przepisów,

- obowiązkami transparentności z Article 50,

- wejściem w życie zasad dla Annex III na oficjalnym timeline,

- i bardziej widoczną egzekucją oraz infrastrukturą wsparcia.

Najświeższy sygnał nie jest teoretyczny. On dzieje się właśnie teraz.

5 marca 2026 Komisja opublikowała drugi draft Code of Practice dotyczącego oznaczania i labelowania AI-generated content. Feedback jest otwarty do 30 marca 2026, a finalizacja jest oczekiwana na początek czerwca 2026.

Dlatego nie traktowałbym transparentności jako dodatku. Jeśli Twój produkt ma assistanty, synthetic content, AI-generated text albo manipulated media, transparentność staje się zachowaniem produktu, a nie tylko językiem polityki.

Błąd, który nadal robi większość zespołów

Wiele zespołów słyszy "regulacja" i od razu myśli "legal memo". Poważne zespoły powinny słyszeć "wymagania system designu".

Pytanie rynku przesuwa się z:

- "Jakiego modelu używacie?"

na:

- "Jak kontrolujecie system wtedy, gdy to naprawdę ma znaczenie?"

To nie jest abstrakcja. Czułem to w produktach takich jak Fotelik, gdzie zaufanie zależy od provenance, explainability i od tego, kiedy system ma milczeć zamiast brzmieć mądrze.

Nawet poza formalną klasyfikacją high-risk presja inżynierska wygląda podobnie:

- potrzebujesz source trail,

- potrzebujesz uczciwych fallbacków,

- potrzebujesz widocznej granicy między grounded i uncertain output,

- potrzebujesz operating modelu na moment, kiedy jakość spada.

Prawo dogania rzeczywistość produktową, która już wcześniej istniała.

Jeśli chcesz to jakoś nazwać, ja dalej nazywam tę odpowiedź Fortress AI. Nie dlatego, że strach dobrze się sprzedaje. Tylko dlatego, że wygrywają systemy pod kontrolą.

Co jest niepewne, a co nie

Jest jeden obszar, gdzie trzeba pisać precyzyjnie.

19 listopada 2025 Komisja przyjęła propozycję uproszczeń w ramach pakietu Digital Omnibus. W tej propozycji stosowanie części zasad high-risk mogłoby przesunąć się na późniejsze long-stop dates, jeśli propozycja zostałaby przyjęta w obecnym kształcie:

- 2 grudnia 2027 dla systemów z Annex III,

- 2 sierpnia 2028 dla części systemów z Annex I objętych harmonisation legislation.

Ale kluczowe słowa brzmią: jeśli zostanie przyjęta.

Na 9 marca 2026 to nadal jest propozycja negocjowana przez Parlament i Radę. Więc bezpieczny odczyt jest taki:

- istnieje niepewność co do części harmonogramu high-risk,

- ale AI Act nie zniknął,

- a milestone 2026 nie przestał mieć znaczenia.

Stabilne fakty dalej są stabilne:

- AI literacy już obowiązuje,

- GPAI obligations już obowiązują,

- Article 50 dalej wskazuje na 2 sierpnia 2026,

- a warstwa wdrożeniowa dalej się aktywnie zmienia.

Jeśli budujesz roadmapę na założeniu, że "i tak wszystko opóźnili", to budujesz ją bardziej na politycznej nadziei niż na obecnej rzeczywistości operacyjnej.

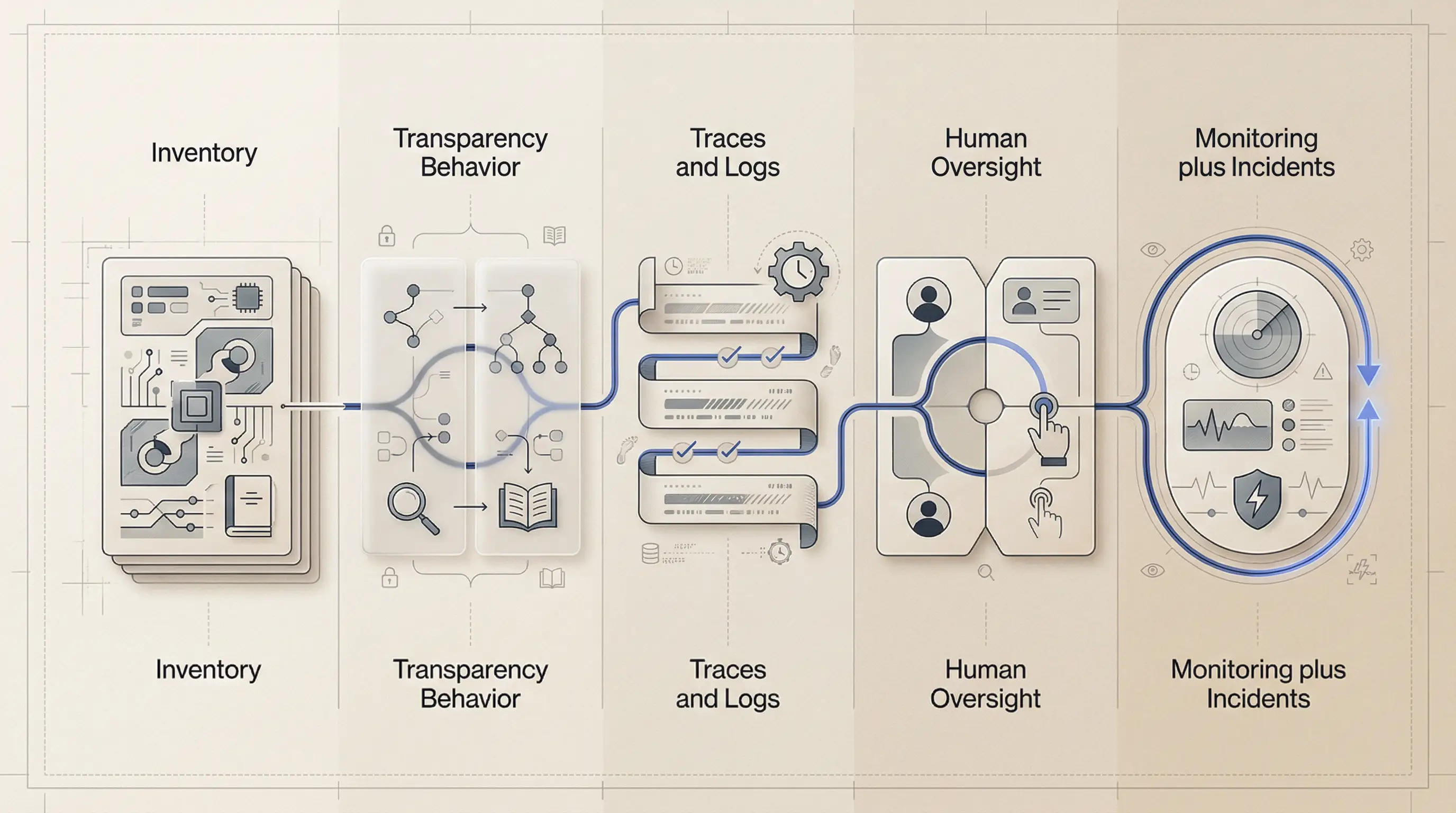

Jaki control stack będą mieć poważne zespoły

Najmocniejsze zespoły w Europie nie wygrają dlatego, że częściej mówią o compliance. Wygrają dlatego, że potrafią pokazać konkretny control stack wokół AI feature'ów.

Dla mnie ten stack ma pięć warstw.

1. Inventory przed architekturą

Najpierw trzeba wiedzieć, gdzie AI naprawdę istnieje w produkcie i operacjach.

To znaczy, że potrzebujesz inventory:

- feature'ów i workflowów wewnętrznych z AI,

- danych wchodzących i wychodzących z systemu,

- wyborów modelu i providera,

- poziomu wpływu na użytkownika,

- i ownera odpowiedzialnego za feature.

Jeśli nie umiesz policzyć własnej powierzchni AI, nie umiesz dobrze sklasyfikować ryzyka, zdefiniować kontroli ani później wyjaśnić decyzji.

2. Transparentność jako zachowanie produktu

Article 50 jest dobrym forcing function, bo zamienia transparentność w coś widocznego.

To nie chodzi tylko o dokumentację. To chodzi o to, co naprawdę widzi użytkownik:

- kiedy wchodzi w interakcję z AI,

- kiedy content jest syntetyczny lub zmanipulowany,

- która część outputu jest grounded,

- czego system nie umiał zweryfikować.

W praktyce to są labelki, disclosures, surfaces ze źródłami, refusal states i prosty język niepewności. Ukryty disclaimer w help center to nie jest strategia produktowa.

3. Logi i trace'y, które da się naprawdę obejrzeć

Dla high-risk automatycznie generowane logi są wprost obowiązkiem. Ale nawet poniżej tego progu trace'y są różnicą między kontrolą a folklorem.

Gdy coś pójdzie źle, trzeba szybko odpowiedzieć na proste pytania:

- jaki model się uruchomił,

- jaka wersja promptu została użyta,

- jakie źródła zostały pobrane,

- jakie narzędzia zostały wywołane,

- jak wyglądał output,

- i jak system zamknął interakcję.

Nawet cienkie trace schema mocno podnoszą jakość operacji:

export type AiTrace = {

traceId: string;

timestamp: string;

feature: string;

model: string;

promptVersion: string;

retrievedSources?: string[];

latencyMs: number;

outcome: "success" | "low_confidence" | "fallback" | "refused" | "error";

};

Jeśli nie umiesz obejrzeć answer path, to tak naprawdę nie kontrolujesz systemu.

4. Human oversight musi istnieć w UI

Jedna z najpraktyczniejszych soczewek w AI Act jest prosta: ludzie mają rozumieć ograniczenia, zauważać anomalie, unikać over-reliance i umieć interweniować.

To nie jest PDF. To jest projekt interfejsu i workflow.

Realny oversight zwykle wygląda tak:

- review przed publikacją w wrażliwych flowach,

- override i correction,

- eskalacja do ownera,

- feature flag albo shutdown capability,

- audit log działań człowieka.

To jest jeden z powodów, dla których uważam, że product engineerowie i mocni frontend engineerowie są w AI niedoszacowani. Oni umieją budować high-stakes surfaces, które pozostają czytelne pod presją.

5. Monitoring i ścieżka incydentów po wdrożeniu

Logika post-market monitoring i serious incidents w AI Act ma znaczenie, bo wymusza dobry nawyk operacyjny: release nie kończy historii jakości.

Potrzebujesz systemu do obserwacji:

- dryfu jakości outputu,

- rosnącego fallbacku albo refusal,

- problemów ze świeżością źródeł,

- szkodliwych wzorców porażki,

- i incydentów, które wymagają formalnej eskalacji.

Dlatego nie oddzielam compliance od reliability. Na poziomie produktu te rzeczy zaczynają się scalać.

O co buyerzy będą coraz częściej pytać

Enterprise buyerzy raczej nie zapytają tylko:

"Czy jesteście compliant?"

Częściej poproszą o dowody w bardziej praktycznej formie:

- Pokażcie, gdzie AI jest używane w produkcie.

- Pokażcie, jak użytkownik jest informowany.

- Pokażcie jeden trace sensownej odpowiedzi albo decyzji.

- Pokażcie, kto może zrobić review, override albo stop.

- Pokażcie, jak monitorujecie jakość po wdrożeniu.

Zespoły, które umieją odpowiedzieć na te pytania artefaktami, będą wyglądały mocniej niż zespoły z bardziej efektownym demo, ale słabszą kontrolą.

To jest zmiana, która mnie interesuje. Europa nie tworzy tylko dodatkowej warstwy policy work. Tworzy przewagę rynkową dla zespołów, które potrafią zamienić trust w zachowanie systemu.

Prawdziwa szansa

Najmocniejsze produkty AI w Europie nie wygrają dlatego, że w demo wyglądają najbardziej magicznie. Wygrają wtedy, gdy buyer, operator i użytkownik uwierzą im także wtedy, gdy stawka rośnie.

Dlatego uważam, że nową przewagą jest control stack:

- inventory,

- transparency behavior,

- trace'y,

- oversight,

- monitoring.

Nie dlatego, że regulacja jest ekscytująca. Tylko dlatego, że zaufanie się kumuluje.

To jest różnica między wypuszczeniem AI feature'a a wypuszczeniem AI systemu, pod którym poważny buyer naprawdę się podpisze.

- Napisz playbook incydentów (co robicie, gdy sypie się w produkcji).

Powiązane artykuły

Najwazniejsze wnioski

- Europa jest już w fazie wdrożenia: AI literacy i obowiązki GPAI już obowiązują.

- 2 sierpnia 2026 dalej ma znaczenie, bo na oficjalnym timeline nadal są Article 50 i szeroka fala stosowania przepisów.

- Możliwe przesunięcia części high-risk to nadal propozycja Komisji, a nie zamknięty stan prawny.

- Wygrają zespoły, które pokażą control stack: inventory, transparency behavior, trace'y, oversight i monitoring.

Zrodla

- EU AI Act (Regulation (EU) 2024/1689) — EUR-Lex

- Komisja Europejska — Regulatory framework on AI

- Komisja Europejska — timeline wdrożenia EU AI Act

- AI Act Service Desk — Article 4 (AI literacy)

- AI Act Service Desk — Article 50 (transparency obligations)

- Komisja Europejska — second draft code on marking and labelling AI-generated content

- Komisja Europejska — standardy i EU AI Act (kontekst Digital Omnibus)

- Komisja Europejska — Navigating the AI Act FAQ

Chcesz taki poziom jakosci w swoim produkcie?

Pomagam zespolom wdrazac AI feature'y, ktore sa szybkie, wiarygodne i gotowe na produkcje.