AI Engineering

Frontend nie umarł. Stał się moją przewagą w Product AI

Feb 10, 2026 · 6 min read

Nie wszedłem w AI dlatego, że frontend przestał mieć znaczenie. Wszedłem, bo produkty AI premiują to, co demo zwykle ignoruje: trust UX, ewaluacje, latency i dyscyplinę dowożenia.

AI nie sprawił, że moje lata na froncie przestały mieć znaczenie

Nie wszedłem w AI dlatego, że frontend przestał mieć znaczenie. Wszedłem, bo praca produktowa przesunęła się o jedną warstwę głębiej.

Przez ponad dekadę budowałem systemy frontendowe i full-stack. Ta praca nauczyła mnie, jak użytkownicy psują flow, jak stan zaczyna przeciekać, jak latencja zmienia zachowanie i jak szybko znika zaufanie po jednej złej interakcji.

To dalej są problemy, które mnie obchodzą. Różnica jest taka, że feature'y AI robią je trudniejszymi.

W 2025 miałem to, co wielu inżynierów nazywa stabilną ścieżką: senior scope, dobre pieniądze, zdalną pracę i życie, które z zewnątrz wyglądało już na poukładane. Ale wcześniej w karierze nauczyłem się też, jak szybko "stabilnie" potrafi się zmienić. To sprawiło, że mniej obchodziło mnie bronienie jednej etykiety, a bardziej zrozumienie, gdzie przesuwa się wartość w inżynierii.

Tak trafiłem do product AI. Nie jako totalny reset. Jako ostrzejsza wersja tego samego instynktu: budować systemy, którym ludzie mogą ufać.

Sygnał z rynku to zmiana wyceny, nie hype

Potrzebowałem nudnego sygnału, nie sloganu. Sensowne pytanie nigdy nie brzmiało: "Czy AI jest duże?" Sensowne pytanie brzmiało: "Gdzie przesuwa się premia?"

16 stycznia 2026 LinkedIn podał, że AI Engineer utrzymał pozycję numer jeden na liście Jobs on the Rise w USA, a role wymagające AI literacy urosły w Stanach o 70% rok do roku. 22 stycznia 2026 Indeed Hiring Lab raportował, że prawie 6% firm w USA miało w listopadzie 2025 co najmniej jedną ofertę związaną z AI, a wśród firm zatrudniających pod AI ponad 2 na 5 ofert zawierało umiejętności AI.

To nie znaczy, że każdy ma zostać researcherem. To znaczy, że kompetencje AI są coraz częściej dopisywane do pracy produktowej, inżynieryjnej i operacyjnej.

Szerszy obraz pokazuje to samo. Future of Jobs Report 2025 od World Economic Forum stawia AI i big data na szczycie najszybciej rosnących grup kompetencji. Stanford AI Index 2025 podał, że z AI korzystało 78% organizacji w 2024 roku, wobec 55% rok wcześniej.

Kiedy tak przeczytałem rynek, pytanie o karierę też się zmieniło. To nie było już "czy powinienem odejść z frontendu?" To było raczej "które części mojego backgroundu będą dobrze rosnąć w produktach AI, a które muszę dobudować?"

Zła reakcja to albo strach, albo cosplay

Ciągle widzę dwie złe reakcje.

Pierwsza to strach: "Frontend umarł. Muszę wymyślić siebie od nowa."

Druga to cosplay: "Jeśli nauczę się paru trików z promptami, mogę nazwać się AI engineerem."

Obie mijają się z prawdziwą zmianą.

Większość firm nie potrzebuje kolejnej osoby, która potrafi zrobić efektowne demo. Potrzebują ludzi, którzy umieją zamienić niepewne zachowanie modelu w powierzchnię produktową, która jest zrozumiała, mierzalna i na tyle bezpieczna, żeby ją wypuścić.

Ta robota siedzi na styku:

- product judgment,

- system designu,

- operacyjnej kontroli,

- i zaufania użytkownika.

I to jest dokładnie miejsce, w którym mocny frontend i product background staje się przewagą.

Product AI, nie demo

To jest linia, do której ciągle wracam: Product AI, not demos.

Demo musi zwykle udowodnić jedną rzecz: "Patrz, model to potrafi."

Produkt musi udowodnić cztery trudniejsze rzeczy:

- feature rozwiązuje realny problem użytkownika,

- użytkownik wie, kiedy temu ufać,

- zespół potrafi sprawdzić, co się stało, kiedy coś pójdzie źle,

- i ekonomia dalej się spina po wdrożeniu.

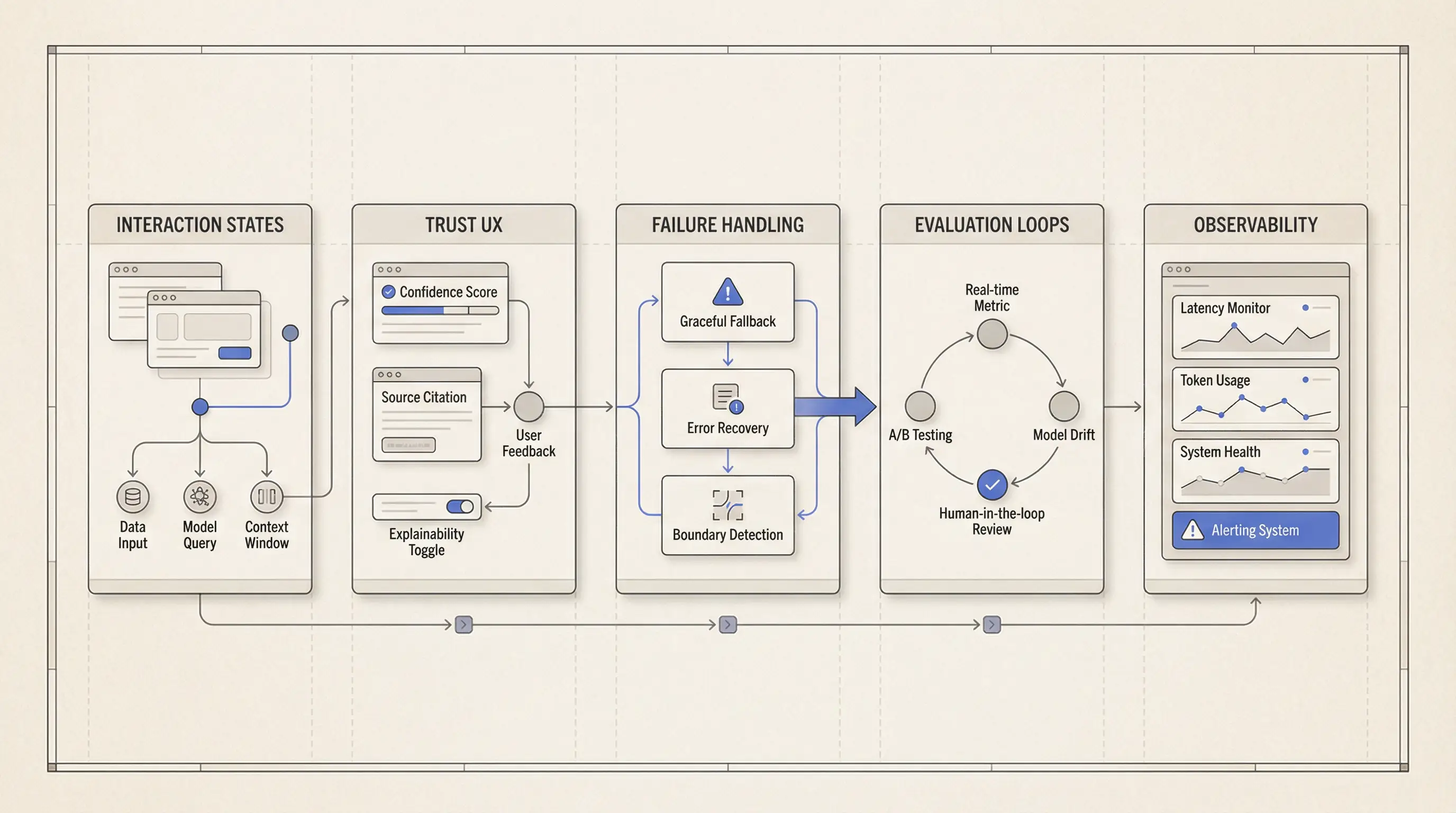

Dlatego bardziej obchodzą mnie:

- pętle ewaluacji, a nie tylko prompty,

- fallback i correction UX, a nie tylko happy pathy,

- budżety latencji i kosztu, a nie tylko jakość modelu,

- grounding i explainability, a nie tylko płynny output,

- dyscyplina release'u, a nie tylko tempo feature velocity.

Jeśli nie umiesz nazwać failure mode'ów, nie kontrolujesz feature'a. Jeśli nie umiesz zobaczyć regresji, nie kontrolujesz systemu. Jeśli UI ukrywa niepewność, użytkownicy ukarzą Cię szybciej niż jakikolwiek benchmark.

Co frontend naprawdę mi dał

Frontend nie przygotował mnie do trenowania foundation models. To nigdy nie był zakład.

Przygotował mnie za to do tych części pracy z product AI, które najszybciej psują się w rzeczywistości.

1. Niepewność jako problem UX

Praca frontendowa uczy myślenia w stanach pośrednich: loading, empty, stale, invalid, blocked, retrying, degraded.

AI dodaje nowe stany, ale nawyk zostaje: low confidence, conflicting sources, tool failure, stale context, partial grounding.

Dlatego tak bardzo obchodzi mnie trust UX. Użyteczny feature AI nie tylko odpowiada. Mówi też użytkownikowi, co wie, czego nie potrafił potwierdzić i co warto zrobić dalej.

2. Dyscyplina dowożenia przy ciągłej zmianie

W Common duża część prawdziwej roboty polegała na tym, żeby skomplikowany frontend produkcyjny był bezpieczniejszy w zmianie. To oznaczało granice architektoniczne, siatki bezpieczeństwa przy migracji, contract tests, Playwright coverage i wycinanie martwych gałęzi zamiast dokładania kolejnej złożoności.

Systemy AI potrzebują dokładnie tego samego odruchu. Prompty się zmieniają. Modele się zmieniają. Dokumenty źródłowe się zmieniają. Tooling się zmienia. Bez guardrails każda "mała poprawka" może zrobić cichą regresję.

3. Instynkt do wydajności i interakcji

Frontendowiec szybko uczy się, że latencja to product design. Kilkaset milisekund potrafi zmienić zachowanie. Blokujący flow bywa porzucany. Źle zaprojektowany loading state uczy użytkownika złych oczekiwań.

Produkty AI robią to tylko droższym. Teraz latencja, koszt tokenów i fallback design są ze sobą mocno spięte. Nie da się oddzielić jakości produktu od zachowania w runtime.

4. Systemy czytelne dla człowieka

Dobra robota frontendowa to nie tylko piksele. To czytelność. Użytkownik powinien rozumieć, gdzie jest, co się wydarzyło i co może zrobić dalej.

W AI ta sama zasada dotyczy odpowiedzi, poprawek, provenance, permissionów i refusal states. Dlatego nie traktuję wyjaśniania jako miłego dodatku. W wielu feature'ach AI wyjaśnienie jest częścią kontraktu produktu.

Proof siedzi w prawdziwych systemach, nie w pobocznych zabawach

Ten ruch stał się dla mnie realny przez systemy, przy których pracowałem, a nie przez samo czytanie o AI.

Common: bezpieczna zmiana w żywym systemie

Common to mocny dowód, że umiem pracować w prawdziwej złożoności. Wartość nie polega tam na "AI". Polega na judgment w architekturze, migration safety nets i refaktorze, który da się dowieźć w żywym produkcie.

To ma w AI większe znaczenie, niż wielu osobom się wydaje. Jeśli warstwa zachowania jest probabilistyczna, reszta produktu musi być bardziej czytelna, a nie mniej.

Waku: płatne AI to system produktowy

Waku to najczytelniejszy zawodowy dowód, że AI product work nie kończy się na model callach. Najtrudniejsze rzeczy były wokół monetyzacji, entitlement logic, prompt orchestration, streaming experience i workflowów dostarczania drogiej generacji.

To nauczyło mnie prostej lekcji: kiedy użytkownicy płacą za zachowanie AI, zaufanie i kontrola przestają być opcją.

Fotelik: explainability w wrażliwym obszarze

Fotelik to mój najmocniejszy niezależny proof produktu AI.

Zbudowałem go wokół structured extraction, scoringu, retrievalu i explainable results w politycznie wrażliwej przestrzeni. To wymusiło lepsze nawyki:

- grounding zamiast black-box answers,

- schema constraints zamiast luźnego outputu,

- human-in-the-loop operations zamiast ślepej automatyzacji,

- oraz semantic retrieval, który musiał służyć wynikowi widocznemu dla użytkownika, a nie tylko wewnętrznemu demo.

Ten projekt bardzo jasno pokazał mi granicę. Trudne pytanie nigdy nie brzmiało "czy model potrafi powiedzieć coś mądrego?" Trudne pytanie brzmiało "czy system potrafi wygenerować coś, czemu użytkownik powinien zaufać?"

Na co tak naprawdę stawiam

Nie stawiam na to, że każda firma potrzebuje wielkiego systemu agentowego. Nie stawiam na to, że prompt engineering sam w sobie stanie się trwałym moat. Nie stawiam na to, że jeszcze jedno generyczne demo AI zrobi wrażenie na poważnym buyerze.

Stawiam na coś węższego:

Premia pójdzie do inżynierów, którzy umieją połączyć:

- product thinking,

- zachowanie systemów AI,

- ewaluację i observability,

- oraz zaufanie użytkownika pod realnymi constraintami.

Dlatego też nie opisuję tego jako totalnej zmiany kariery. To bardziej strategiczne skompresowanie skillów, które już miałem: produktowy zmysł, frontendowy rygor, full-stack delivery i skłonność do budowania systemów, które da się operować.

Dodałem nowe warstwy. Nie wyrzuciłem starych.

Co to znaczy, jeśli ktoś zatrudnia mnie do AI

Jeśli ktoś bierze mnie do pracy przy AI, to zadanie nie brzmi "spraw, żeby model gadał."

Najczęściej brzmi raczej tak:

- zdefiniuj, gdzie AI daje realną wartość produktową,

- spraw, żeby niepewność była używalna w interfejsie,

- zaprojektuj czysto granice retrievalu, promptingu albo tool use,

- dołóż evale, trace'y i release gates,

- oraz utrzymaj jawne latency, koszt, safety i governance.

To jest rodzaj pracy, którego chcę więcej. I to jest też rodzaj pracy, który to portfolio ma udowadniać.

Zakład

Nie postawiłem na AI dlatego, że frontend przestał mieć znaczenie. Postawiłem na AI dlatego, że kolejna premia nie będzie już tylko za polerowanie interfejsu. Będzie za inżynierów, którzy potrafią połączyć judgment na interfejsie, kontrolę systemu i zachowanie modelu w jeden produkt.

Frontend nie był złą bazą. Dla systemów AI, które chcę budować, był jedną z najlepszych.

Najwazniejsze wnioski

- Najmocniejszy sygnał AI na początku 2026 to nie hype, tylko zmiana wyceny: coraz więcej firm i ról oczekuje kompetencji AI jako części pracy produktowej.

- Doświadczenie frontendowe dobrze przenosi się do product AI, bo uczy pracy z niepewnością, failure state'ami, latencją i zaufaniem użytkownika.

- Premia nie jest za ładne prompty. Premia jest za zamienienie niepewnego zachowania modelu w używalny i inspekcyjny system.

- Prawdziwy proof bierze się z dowiezionych systemów z ograniczeniami i trade-offami, a nie z cienkich projektów pobocznych.

Zrodla

- Indeed Hiring Lab — umiejętności AI pojawiają się już w ponad 2 na 5 ofert w firmach zatrudniających pod AI (22 stycznia 2026)

- LinkedIn — AI Engineer utrzymał pozycję #1 w USA, a popyt na AI literacy urósł o 70% r/r (16 stycznia 2026)

- World Economic Forum — Future of Jobs Report 2025

- Stanford HAI — 2025 AI Index Report

Chcesz taki poziom jakosci w swoim produkcie?

Pomagam zespolom wdrazac AI feature'y, ktore sa szybkie, wiarygodne i gotowe na produkcje.